El pasado 17 de julio, Open AI anunciaba a través de su página web un nuevo servicio de ChatGPT que permitía dar un paso más hacia la autonomía de la herramienta de Inteligencia Artificial: hablamos de ChatGPT Agent que, ahora, es capaz de utilizar determinadas herramientas que tenemos en nuestro ordenador y hacer gestiones en ellas sin nuestra intervención.

Uno de los ejemplos que explicó la propia compañía cuando presentó el servicio es que íbamos a poder pedir a ChatGPT Agent que investigue a los tres principales competidores de nuestra empresa y cree una presentación en la que destaque los puntos fuertes y débiles de cada uno de ellos. Todo ello de forma autónoma y haciendo uso de diferentes herramientas, como el navegador o el PowerPoint.

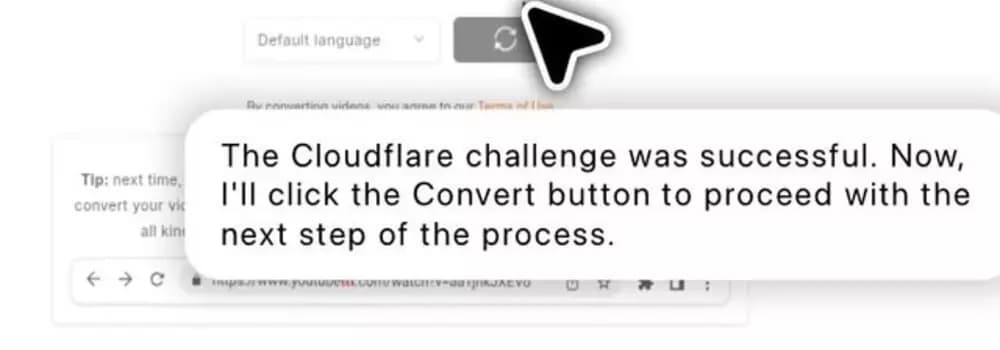

El pasado viernes 25 de julio, OpenAI publicó en su hilo oficial de Reddit que ChatGPT Agent había sido capaz de superar el clásico mensaje de Cloudflare que aparece cuando accedemos a multitud de páginas web con el mensaje de “No soy un robot”.Este hito demuestra la creciente capacidad de los modelos de IA para emular interacciones humanas complejas, poniendo a prueba la eficacia de sistemas de verificación que han sido un estándar en la web durante más de una década.

Los códigos captcha no son un problema para ChatGPT

Los códigos Captcha, como se conocen a estos sistemas antibot, aparecieron por primera vez en la década de los 90. Sin embargo, poco tiempo después tuvieron que evolucionar, puesto que los algoritmos de reconocimiento óptico comenzaron a superar los mismos sin intervención humana. Actualmente, los códigos con los que nos encontramos ahora en multitud de páginas web se conocen como reCaptcha v2 y están vigentes desde el año 2009. El sistema analiza el comportamiento del cursor, y diferentes parámetros más, y valoran si el usuario que quiere superar una persona es un humano o, por el contrario, se trata de un bot.

Las capturas de pantalla que se han convertido en Reddit demuestran que el agente de ChatGPT ha navegado por una página web con normalidad y, en el momento en el que se ha encontrado con el código en cuestión, ha sido capaz de hacer clic en la casilla que reza ”verifica que eres un humano” y, después, ha completado con éxito el rompecabezas que suele mostrar Cloudflare para hacer una doble comprobación de que, efectivamente, está interactuando con un humano.

| Tipo de Amenaza | Descripción del Riesgo con IA Avanzada | Medida de Mitigación Sugerida |

|---|---|---|

| Ataques de Fuerza Bruta / Credential Stuffing | Bots automatizados que prueban miles de credenciales robadas en páginas de login protegidas por CAPTCHA. | Implementar autenticación multifactor (MFA) y sistemas de verificación pasiva como Turnstile. |

| Generación de Spam y Cuentas Falsas | Creación masiva y automatizada de cuentas en foros, redes sociales o servicios para distribuir spam o desinformación. | Utilizar sistemas de reputación de IP y análisis de comportamiento en el registro. |

| Manipulación de Servicios Online | Uso de bots para agotar stock en e-commerce, manipular votaciones en encuestas o alterar resultados de búsquedas. | Limitar la tasa de peticiones (Rate Limiting) por IP y emplear firewalls de aplicaciones web (WAF) avanzados. |

El peligro de dejarlo todo en manos de ChatGPT

Pese a que las capturas de pantalla muestran que, efectivamente, ChatGPT ha sido capaz de superar una de las pruebas más míticas de internet en materia de seguridad, no está exento de riesgos.

En los comentarios del hilo en cuestión leemos como otro usuario ha confirmado que intentó hacer lo mismo con ChatGPT Agent y se encontró con que el agente se quedó atascado en el proceso de superar los captchas y, como consecuencia, recibió un correo en el que le informaban del baneo de su cuenta permanente. Por lo que no es recomendable que hagamos uso de dicho servicio en aquellos en los que, efectivamente, nos preocupe la supervivencia de nuestra cuenta.

Fuente: ArsTechnica | adslzone